L’irruption des Juges AGI : Contexte et État de l’Art

Depuis quelques années, l’idée de juges AGI (Artificial General Intelligence), capables de rendre des décisions impartiales, franchit de nouveaux seuils dans la sphère de la justice, de la régulation internet et de l’arbitrage automatisé. Face à l’explosion des litiges numériques, des fraudes à grande échelle et du volume des conflits IA/IA, les instances régulatrices explorent le potentiel des AGI Judges pour automatiser la résolution des différends complexes tout en garantissant l’équité.

Des expérimentations concrètes émergent dès 2024 en Estonie et en Chine, avec des tribunaux numériques où l’IA gère déjà des litiges mineurs ou commerciaux. En 2026, ces initiatives prennent de l’ampleur : à Dubaï, la Cour numérique centralise l’usage d’IA générative pour l’arbitrage en ligne ; dans l’UE, plusieurs villes pilotes installent des jurys mixtes (juges AGI supervisés par des experts humains) pour trancher des litiges en propriété intellectuelle ou modérer la désinformation automatique sur les réseaux sociaux.

La priorité s’impose autour de trois axes majeurs :

- Arbitrage entre intelligences artificielles (IA/IA) pour régler des conflits commerciaux entre agents autonomes.

- Résolution accélérée des litiges numériques complexes impliquant plateformes, créateurs, et utilisateurs, hors de portée des procédures judiciaires classiques.

- Lutte automatisée contre la désinformation et la fraude, où l’AGI fonctionne comme un « gendarme » numérique, vérifiant et statuant sur des milliards de contenus quotidiennement.

Pour une analyse sur les innovations de gouvernance par l’IA, consultez également cet article majeur sur la gouvernance déléguée par AGI.

Architecture, Fonctionnement et Limites Actuelles des Juges IA Généralistes

Les juges AGI sont le fruit de progrès spectaculaires en intelligence artificielle générale. Leur architecture cognitive combine des modèles de langage avancés, des réseaux neuronaux profonds et une intégration fine de bases de connaissance juridiques, historiques et contextuelles. À l’échelle des IAG opérationnels en 2026, l’apprentissage se fait sur d’immenses bases de jurisprudence mondiale, tandis que des modules spécifiques d’explicabilité (XAI) tracent chaque raisonnement.

Ce fonctionnement hybride inclut souvent une supervision humaine, pour l’entraînement des juges intelligents et la validation de leurs raisonnements sur les cas sensibles. Plusieurs plateformes d’arbitrage AGI proposent, par exemple, un double examen (IA puis panel humain) pour rassurer utilisateurs et institutions.

Mais ces architectures restent confrontées à des limites majeures : le contrôle des biais algorithmiques n’est jamais totalement acquis, la pression pour une explicabilité complète reste intense, et la résistance à la manipulation des entrées ou à l’ingénierie inverse pose de nouveaux défis. En 2026, il existe une forte demande de transparence sur les critères de décision- une question centrale explorée dans notre article sur l’auditabilité et le contrôle citoyen des AGI.

Tableau comparatif des architectures AGI judges (2026) :

| Type | Supervision humaine | Explicabilité | Usage |

|---|---|---|---|

| Algorithme propriétaire | Faible | Modérée | Arbitrage rapide, décisions standard |

| AGI open source hybride | Forte | Élevée | Cas complexes, audits indépendants |

Pour mieux comprendre les tensions entre propriétarisation et modèles ouverts dans l’AGI, découvrez notre analyse approfondie.

Débats éthiques et politiques : déléguer la justice à l’AGI ?

L’émergence des juges AGI soulève de puissants débats éthiques et politiques. Peut-on confier des décisions de justice à une intelligence artificielle ? Si l’argument de rapidité et de réduction du coût judiciaire séduit, nombre d’acteurs alertent sur les risques d’arbitraire algorithmique ou de pertes du lien humain.

Trois niveaux de controverse émergent :

- Acceptabilité sociale : Les usagers craignent la » justice sans visage « , l’absence d’empathie ou la reproduction de biais systémiques.

- Neutralité et légitimité : ONG et juristes interrogent la légitimité d’une justice déléguée à l’AGI notamment en cas de conflits inter-états ou de minorités.

- Statut juridique des décisions IA : En 2026, plusieurs juridictions européennes et asiatiques ont ouvert des chantiers sur le statut légal des juges AGI- souvent, leurs décisions nécessitent un tampon officiel ou un recours humain.

La réponse institutionnelle varie: certains tribunaux adoptent un principe de co-validation humain-IA, d’autres prônent la réversibilité. Les grandes organisations internationales comme l’ONU ou l’UE lancent des groupes de réflexion sur l’avenir du droit à l’ère de la superintelligence artificielle. Pour aller plus loin sur l’impact de l’AGI sur la culture scientifique et le droit, lisez notre article sur la rédaction scientifique à l’ère de l’IA générale.

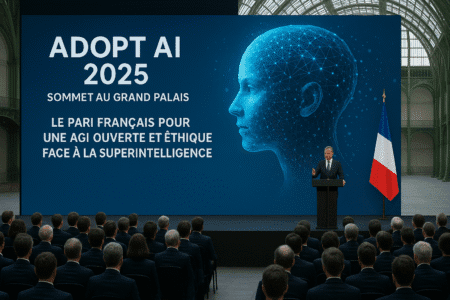

Vers la Superintelligence, Arbitre Universel ? Scénarios Futuristes et Souveraineté

À l’horizon 2030, certains prospectivistes imaginent un monde où la résolution automatique des conflits par des juges AGI superintelligents transcende les frontières nationales. Dans ces scénarios, leur intervention s’étend des litiges économiques transnationaux à la modération des conflits diplomatiques, jusqu’à la gestion d’incidents entre intelligences artificielles autonomes appartenant à des entités rivales (entreprises, états, collectifs citoyens).

Un vaste débat s’ouvre : la souveraineté numérique des États risque d’être bousculée, au profit de mécanismes d’arbitrage pilotés par des AGI neutres et transparents… ou biaisés par des intérêts géopolitiques cachés. Le rêve d’une « justice planétaire » repose alors sur la capacité à imposer des standards d’auditabilité, de réponse à la demande de recours, ou d’accès universel aux critères de jugement.

Mais la dérive dystopique n’est jamais loin: quid de la surveillance totale, du risque de monopole algorithmique ou des stratégies de contournement pour manipuler l’AGI arbitre ? Ces spectres ramènent à l’importance de la co-construction humain-machine et d’une pluralité d’expertises, dont certaines requièrent des scripts open source et le contrôle citoyen, comme discuté dans cette analyse de terrain.

Conclusion : Pour une justice augmentée ou une technocratie algorithmique ?

Les juges AGI et la résolution automatique des conflits numériques dessinent la prochaine frontière de l’intelligence artificielle générale. Mais la question reste brûlante: voulons-nous une justice augmentée, enrichie par la rapidité et la rigueur de l’IA, ou risquons-nous glisser vers une technocratie algorithmique, où l’humain perd toute prise sur la norme ?

Face à ces choix, la co-construction des règles et la vigilance s’imposent. Il est urgent de développer des garde-fous robustes: auditabilité permanente, recours obligatoire à l’humain pour les cas sensibles, transparence sur le fonctionnement de l’IAG, et ouverture des plateformes aux inspections publiques ou citoyennes.

Pour que l’AGI reste un outil au service du collectif, et non une boîte noire infaillible, la voie de la collaboration humain-machine, des mécanismes de recours diversifiés et d’une régulation internationale stricte apparaît comme la meilleure garantie d’une justice éthique et souveraine à l’ère de la superintelligence artificielle.