À l’heure où l’AGI créative produit la majorité des contenus tech et scientifiques visibles, une nouvelle crise de confiance s’installe. Fake papers, deepfakes de vulgarisation, stratégies émergentes pour authentifier l’information : ce dossier inédit explore les nouveaux doutes et les (vraies) réponses de la communauté.

Lire la suite...Recherche augmentée : plongée dans le quotidien des duos Homme-AGI en laboratoire scientifique (2026)

En 2026, la frontière entre intelligence humaine et intelligence artificielle générale se brouille dans les laboratoires : en exclusivité, découvrez comment chercheurs et AGI co-écrivent, publient et innovent ensemble, et comment naissent les nouveaux métiers du co-pilotage cognitif.

Lire la suite...Collectifs Créatifs AGI : La Nouvelle Révolution Collaborative entre IA Générale et Communautés Makers

L’AGI générative n’est plus réservée aux laboratoires : en 2026, elle infuse les collectifs créatifs indépendants et les communautés makers. Explorez la révolution des plateformes collaboratives qui fusionnent imagination humaine, algorithmes ouverts et superintelligences artistiques dans l’art, le design et le jeu vidéo.

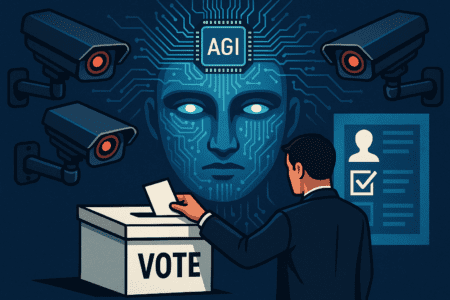

Lire la suite...AGI, Élections et Manipulation Cognitive : Vers une Démocratie Sous Surveillance Algorithmique ?

La frontière entre combat démocratique et manipulation cognitive s’estompe : l’AGI commence à façonner secrètement la sphère électorale mondiale. Décryptage inédit de ce que prépare l’intelligence artificielle générale pour le futur du vote et de la participation citoyenne.

Lire la suite...Fuites de modèles AGI : Leaks, clones et nouvelles menaces sur la superintelligence

En quelques semaines, la circulation clandestine de modèles et données AGI confidentiels s’est accélérée, bouleversant la sécurité, la confiance et l’avenir de la superintelligence. Plongée dans les dessous d’un tabou technologique qui pourrait redéfinir l’ère numérique.

Lire la suite...L’ère de la « mémoire augmentée » : AGI, souvenirs, identité et confiance collective sous pression

Plongée exclusive dans un sujet explosif : l’arrivée d’assistants AGI capables d’archiver et d’influencer nos souvenirs bouleverse-t-elle l’identité humaine et la confiance collective ? Décryptage, scénarios et alertes d’un futur déjà en gestation.

Lire la suite...AGI Microlocale : La Révolution des Intelligences Généralistes de Quartier Déferle en 2026

Une révolution aussi discrète que décisive secoue l’intelligence artificielle en 2026 : l’avènement des AGI ‘microlocales’, des intelligences généralistes créées et adaptées pour des groupes, quartiers ou communautés spécifiques. Décryptage d’un mouvement qui redéfinit la proximité numérique, accélère la personalisation collective… et questionne nos futurs modèles de société.

Lire la suite...Auditabilité et hallucinations des AGI : Le nouvel impératif de la fiabilité cognitive forte

Les hallucinations cognitives de l’AGI explosent avec son déploiement massif : quelles causes, quels enjeux industriels et scientifiques, et quelles solutions pour restaurer la confiance dans l’intelligence artificielle forte ? Plongez dans l’enquête sur la future norme de fiabilité cognitive.

Lire la suite...Éthiciens IA Open Source : La Nouvelle Avant-Garde de l’Alignement face à l’Explosion de l’AGI en 2026

Explosion de l’AGI, AI Act, moratoires impuissants : en 2026, une nouvelle génération d’« éthiciens IA » indépendants invente des frameworks open source d’alignement éthique, bousculant les modèles industriels traditionnels. Découvrez l’avant-garde décentralisée de l’éthique AGI — et pourquoi elle pourrait enfin créer la confiance.

Lire la suite...Meta-Discipline AGI : L’Émergence des « CognoPols », Nouveaux Laboratoires Cognitifs sur les Campus Mondiaux

Alors que la bataille pour le contrôle éthique et réglementaire de l’AGI fait rage à l’échelle globale, une révolution presque silencieuse secoue les campus : l’essor fulgurant des méta-laboratoires “CognoPols”. Quels sont ces nouveaux pôles de recherche, d’apprentissage et d’innovation cognitive où humains et intelligences artificielles généralistes collaborent au quotidien ? Décryptage d’un phénomène qui pourrait bien remodeler l’université et la société de demain.

Lire la suite...