Introduction: 2025, l’année charnière de la régulation mondiale de l’IA forte

Le 1er août 2025 marque une véritable bascule dans l’histoire de la intelligence artificielle : l’entrée en vigueur de l’AI Act européen. Fait inédit, cette régulation cherche à encadrer de façon inédite l’IA générale (AGI, pour intelligence artificielle générale) et la superintelligence-ce palier où la technologie dépasserait potentiellement toutes les capacités cognitives humaines. Pourtant, alors même que l’Europe renforce sa ligne, des géants de la tech, Meta en tête, choisissent de résister ou de contourner ces nouvelles normes. Leur réaction n’est pas isolée, et révèle un profond clivage dans la gouvernance mondiale de l’IAG, à l’heure où la compétition internationale redéfinit les équilibres économiques, scientifiques et éthiques. Plongée au cœur d’une guerre des normes où chaque stratégie engage l’avenir de l’intelligence artificielle générale et la sécurité globale.

AI Act : la nouvelle donne réglementaire sur l’IA générale et la superintelligence

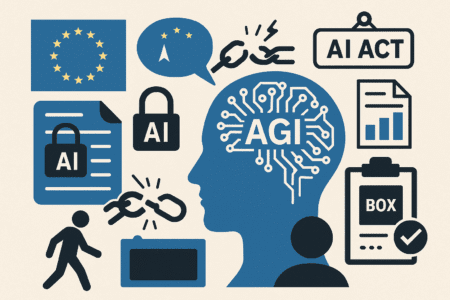

L’AI Act européen, premier cadre légal complet sur l’IA au monde, structure la régulation avec une approche basée sur le risque : plus une technologie s’approche du seuil de AGI (Artificial General Intelligence), plus les contraintes s’élèvent. Les GPAI (General Purpose AI) et modèles fondationnels à potentiel de superintelligence sont soumis à des exigences majeures :

- Obligation de transparence sur l’origine des données utilisées et les mécanismes de la prise de décision algorithmique ;

- Documentation technique détaillée, audits réguliers et procédures de redressement en cas de défaillance ;

- Systèmes robustes de contrôle humain pour limiter les risques d’autonomie incontrôlée ;

- Signalement obligatoire des incidents majeurs auprès des autorités européennes ;

- Respect de normes éthiques strictes concernant la sécurité, la non-discrimination et la protection des droits fondamentaux.

Plus d’informations détaillées sont disponibles dans ce résumé actualisé et sur le site officiel de l’UE. Ces dispositifs visent à faire de l’Europe un leader mondial d’une intelligence artificielle éthique et sûre, tout en influençant les standards globaux. Cette ambition d’encadrement fait écho à la nouvelle diplomatie portée sur la scène internationale, à l’instar de l’initiative chinoise du 27 juillet 2025 qui relance le débat sur la gouvernance mondiale de la superintelligence artificielle.

Meta et la résistance des géants : récits, intérêts et stratégies de contournement

En juillet 2025, Meta a officiellement refusé de signer le code de bonne conduite européen pour les modèles d’intelligence artificielle générale (source), jugeant le texte trop » incertain sur le plan légal » et potentiellement néfaste pour l’industrie. Cette prise de position, relayée par Joel Kaplan (Chief Global Affairs Officer), s’accompagne de stratégies multiples :

- Lobbying intensif à Bruxelles et auprès des gouvernements membres pour assouplir certaines clauses clés du texte ;

- Création d’alliances alternatives, notamment avec des géants américains et asiatiques non-signataires ;

- Diversification de l’innovation hors d’Europe : laboratoires et déploiement de nouveaux modèles avancés hors du champ d’application du AI Act ;

- Multiplication des partenariats extraterritoriaux (ex : Silicon Valley, Dubaï, Asie) pour un développement hors-norme.

Meta n’est pas seul: d’autres entreprises majeures (par exemple, Amazon, certains acteurs chinois et OpenAI pour certaines clauses selon ce rapport) adoptent des positions similaires ou tempèrent leur engagement. En outre, des États comme le Royaume-Uni ou la Chine développent des cadres concurrents, plus souples ou centrés sur la souveraineté technologique (voir leur approche). Dans ce contexte, la rivalité Meta vs. Europe cristallise la diversité des visions sur la régulation de l’IA générale, ouvrant une ère d’incertitude normative. Ce bras de fer rejoint l’analyse approfondie de la tension dans notre dossier sur l’AI Act et la résistance des géants IA.

Scénarios alternatifs: vers une fragmentation de la gouvernance mondiale?

Face à l’opposition de grandes entreprises et d’États influents, le spectre d’une fragmentation de la gouvernance mondiale de l’intelligence artificielle générale se dessine. Plusieurs scénarios émergent:

- Création de « zones hors-norme »: laboratoires et hubs d’innovation délocalisent leurs travaux sur l’IA générale vers des juridictions plus souples ou fragmentent le développement pour échapper à la régulation.

- Fuite des talents et des investissements: les régions hors Europe attirent chercheurs et capitaux en promettant moins de contraintes réglementaires.

- Prolifération de modèles open source non alignés : certains consortiums privés publiant leurs technologies de façon ouverte, hors des cadres européens, soulevant des défis majeurs en matière de sécurité et d’éthique (voir synthèse du World Summit AI).

- Accords bilatéraux et coalitions privées : émergence de mini-accords de gouvernance à l’initiative de pays ou de groupes d’entreprises, comme ceux visibles autour de la Chine, des États-Unis, ou via des forums multilatéraux ( Global AI Governance Action Plan 2025).

Cette dynamique fait craindre une dilution de l’efficacité des normes internationales, un retour des risques de superintelligence non contrôlée et une montée des enjeux éthiques/sécuritaires. Pour mieux comprendre cette nouvelle géopolitique de l’AGI, lire aussicette analyse des initiatives chinoises et l’apport récent de l’ONU en faveur d’une gouvernance plus inclusive.

Quels enjeux pour la communauté IA, les chercheurs et les innovateurs?

Pour les étudiants, chercheurs, développeurs et professionnels de l’intelligence artificielle générale, l’entrée en vigueur du AI Act impose de nouvelles responsabilités, mais aussi de réelles opportunités. Côté formation et recherche, toutes les universités européennes doivent garantir la conformité de leurs laboratoires, assurer une transparence accrue et renforcer la sécurité des données, tout en respectant les règles d’éthique et de non-discrimination. Les chercheurs opérant au niveau transnational devront particulièrement veiller à la documentation et l’auditabilité de leurs modèles.

Pour les professionnels et innovateurs, la multiplication des normes appelle à une veille technologique renforcée, via:

- la consultation régulière des avancées règlementaires;

- le recours à des outils de conformité automatisés et à des audits internes fréquents;

- le maintien d’une IA générale explicable, traçable et sous contrôle humain;

- la participation à des coalitions ouvertes et forums européens ou globaux pour anticiper l’évolution des cadres (par exemple : initiatives ONU ou réseaux spécialisés comme Meta Superintelligence Labs analysé dans cet article).

L’environnement multi-normatif futur nécessitera une approche agile, collaborative et consciente des risques. Les conseils fondamentaux : documenter chaque étape de carrière, se former en continu, et rester informé sur la superintelligence artificielle en s’adossant aux meilleures pratiques internationales.

Conclusion : Entrée en résistance ou transition vers un nouvel équilibre mondial?

L’arrivée de l’AI Act en août 2025 marque un basculement crucial dans la gouvernance de la intelligence artificielle mondiale. Si la résistance affichée par Meta et d’autres géants mondiaux suscite une réelle inquiétude quant à l’universalité des normes, elle cristallise aussi l’urgence d’inventer de nouvelles formes de coopération et de mutualisation éthique.

Ce moment-charnière n’est peut-être qu’une transition: la quête d’un équilibre entre innovation, souveraineté et sécurité. Les chantiers de la gouvernance éthique s’ouvrent désormais à l’échelle paneuropéenne et internationale, mobilisant États, chercheurs et citoyens. Participez au débat sur la IAG en partageant votre avis, vos expériences et vos attentes quant à cet avenir partagé de l’intelligence artificielle générale. La guerre des normes ne fait que commencer: à chacun de s’en emparer!