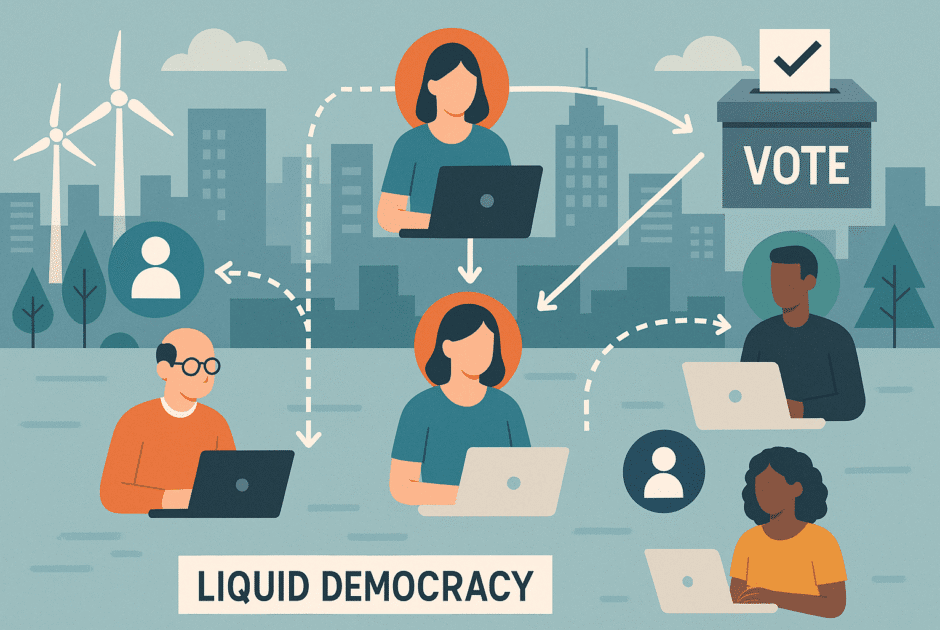

Introduction: Liquid democracy et AGI, le retour du laboratoire citoyen

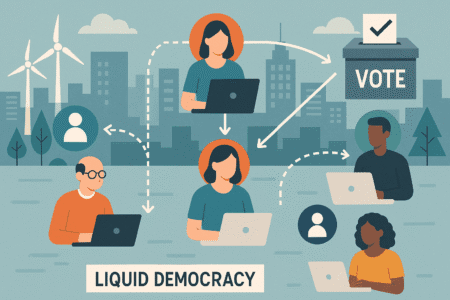

Au carrefour des innovations civiques et des avancées en ia générale, la » liquid democracy » fait un retour remarqué en ce début 2026. Ce modèle hybride, entre démocratie directe et représentative, permet à chaque citoyen de voter sur les sujets de son choix ou de déléguer son vote à une personne – ou à une entité – jugée plus compétente. L’arrivée de l’intelligence artificielle générale (AGI) a profondément renouvelé l’intérêt pour ces dispositifs, offrant à la gouvernance participative un outil d’aide à la décision inégalé.

De nouveaux laboratoires citoyens voient le jour : des villes, universités, collectivités, portées par la volonté de dépasser les limites des procédures classiques et de lutter contre la défiance institutionnelle. Initiatives collectives, algorithmes de supervision et IAG assistent les débats, synthétisent des arguments en temps réel et proposent des solutions adaptées à la complexité des enjeux urbains ou universitaires. Cette vague fait écho à l’essor des agents cognitifs open-source et à la montée des scripts citoyens pour surveiller et corriger les biais dans l’AGI citoyenne.

Ce regain d’intérêt n’est pas anodin : face à la complexité croissante et à la nécessité d’une meilleure transparence, chercheurs, développeurs, et citoyens se rassemblent autour des promesses – mais aussi des défis – de la intelligence artificielle en politique. La liquid democracy, revisitée par l’AGI, deviendra-t-elle la pierre angulaire d’une nouvelle ère civique ou reste-t-elle un mirage technologique?

Premiers pilotes: Zoom sur des villes et campus qui testent l’AGI déléguée

En 2026, plusieurs signaux faibles font état d’expérimentations à l’échelle locale et académique, là où la intelligence artificielle générale agit comme facilitateur de la prise de décision collective. Aux États-Unis, la petite municipalité de Blakewood, Colorado, s’est illustrée en lançant une plateforme de vote délégué assistée par AGI : les citoyens pouvaient déléguer leur voix à des agents hybrides, mélange de représentants élus, de collectifs d’AGI et d’experts indépendants. L’enjeu principal: rendre la participation plus simple sans sacrifier la souveraineté citoyenne.

Côté universités, le campus de Maastricht, aux Pays-Bas, a mis en place des conseils étudiants pilotés par des protocoles de délégation algorithmique, permettant, grâce à l’AGI, l’analyse en profondeur de chaque proposition et la gestion transparente des « pouvoirs » confiés. D’autres universités telles que l’ETH Zurich et The New School à New York s’ouvrent à ces formes innovantes de gouvernance algorithmique, s’inspirant de plateformes ouvertes telles que Decidim (Barcelone) ou de l’usage de Polis à Taïwan, adaptées à la nouvelle donne de l’intelligence artificielle généraliste.

Les points communs? Outils de vote intelligent, tableaux de synthèse générés par l’IAG, et des systèmes de vérification participatifs. Mais les limites aussi sont notables : latence dans les prises de décision complexes, dépendance au code source et opacité d’architecture. Ces expérimentations inspirent une course à la transparence et à l’amélioration continue, tandis que la gouvernance algorithmique fait débat dans les sphères publiques et académiques.

Les promesses et dangers de la gouvernance AGI partagée

La gouvernance partagée par l’AGI promet de révolutionner la participation citoyenne. Grâce à l’ia générale, chacun peut accéder à une information traitée, à des synthèses d’arguments débarrassées de biais manifestes, et déléguer l’analyse de propositions complexes, limitant la surcharge cognitive. Cette assistance intelligente favorise l’émergence d’une démocratie plus inclusive, où la manipulation et la paresse intellectuelle trouvent moins de place. L’intelligence artificielle générale permet aussi, au sein des conseils citoyens ou universitaires, de proposer des cycles de délibération et d’auto-amélioration continue des règles du jeu démocratique.

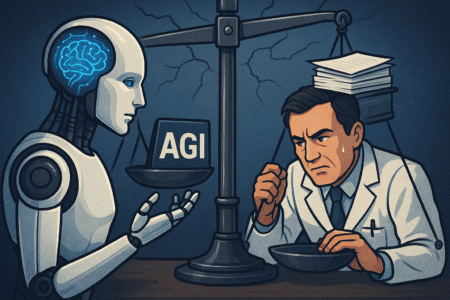

Mais les dangers sont réels. Experts et premiers usagers, selon des retours publiés dans des analyses récentes, mettent en garde contre une dépendance excessive à l’AGI: la perte de la responsabilité proprement humaine, l’opacité des algorithmes propriétaires même partiellement open source, ou encore le risque de hacking politique par manipulation algorithmique dirigée. La centralisation de l’expertise au sein de collectifs d’IAG soulève, en écho aux débats sur la montée des scripts open source pour surveiller les biais (voir cet article), la question cruciale de l’auditabilité, de l’accessibilité citoyenne à la compréhension des décisions et des standards d’éthique à imposer.

Alors que la » liquid democracy » version AGI séduit, le spectre d’une technocratie algorithmique plane. Les débats s’intensifient pour trouver l’équilibre entre apport technologique, souveraineté populaire et sécurité démocratique, en s’appuyant sur des exemples réels et sur des lectures prospectives (découvrir le rôle des agents cognitifs).

Vers quelles évolutions : la co-construction lois et chartes à l’aide de l’AGI?

À mesure que les villes et les campus s’approprient la gouvernance déléguée par intelligence artificielle générale, des scénarios prospectifs émergent : d’un côté, la tentation de généraliser à l’échelle de municipalités plus grandes et pourquoi pas, de gouvernements régionaux; de l’autre, le rêve d’une co-construction des lois et chartes, assistée ou même initiée par l’AGI, en symbiose avec les citoyens.

Dans certains modèles pilotes, l’ia générale compile en temps réel les suggestions citoyennes, crée des métriques d’impact, et propose des rédactions synthétiques de textes législatifs ou de conventions d’organisation intérieure, ensuite amendées via débats humains et votes intelligents. Cette capacité à » nourrir » le débat parlementaire promet une transformation des processus politiques, mais interroge : jusqu’où doit aller l’autonomisation de l’IA? Comment préserver la légitimité populaire? Les premiers bilans pointent la nécessité de chartes de déontologie coconstruites, à la manière de ce que proposent certains campus pilotes.

Enfin, le débat s’ouvre à l’international: quelles normes face à la pluralité des contextes et la future » jungle réglementaire » évoquée dans l’analyse récente? La montée en compétence des citoyens, l’appropriation d’outils open source et la transparence restent des garanties face au risque d’une hyper-technocratie. Reste à imaginer le juste équilibre entre expertise algorithmique et souveraineté humaine, à l’heure où l’Afrique s’impose déjà dans la diplomatie de la superintelligence.

Conclusion : Laboratoire civique ou mirage technocratique ?

La gouvernance déléguée assistée par intelligence artificielle générale marque-t-elle une rupture civique ou un simple mirage technocratique? Face aux avancées rapides des villes pilotes et des campus universitaires, la question éthique revient en force. L’IAG et l’AGI peuvent contribuer à dépasser la crise de confiance démocratique, mais la façade high-tech ne saurait masquer les zones d’ombre: opacité des processus, concentration des pouvoirs algorithmiques, risques d’ingénierie sociale incontrôlée.

Pour les années à venir, le devenir du couple ia générale / démocratie dépendra de la vigilance collective : auditabilité des algorithmes, formation citoyenne, établissement de garde-fous éthiques et juridiques. L’innovation démocratique portée par la liquid democracy et l’intelligence artificielle générale doit cultiver l’ouverture, l’expérimentation, mais aussi la prudence face à la fascination liée aux promesses de l’AGI.

En 2030, saurons-nous faire de ces expérimentations un réel laboratoire civique, pluraliste et inclusif, ou succomberons-nous à la tentation du pilotage automatisé ? La ligne rouge, entre automatisation de la décision et préservation de la souveraineté populaire, reste à tracer – une frontière mouvante au cœur de la gouvernance de l’intelligence artificielle au niveau humain.