Un été de doutes : la bulle IA au prisme des chercheurs

L’été 2024 a vu émerger un climat de doutes et de débats intenses au sein de la communauté scientifique autour de l’hypothétique bulle IA. Les tribunes et prises de position sceptiques se sont multipliées, tant chez les experts techniques que chez les économistes. Parmi les publications marquantes, la Société Française des Traducteurs alerte sur les risques d’une » bulle de productivité » déconnectée de la réalité des usages, tandis que le rapport de l’Ifri (juin 2024) met en garde contre des investissements massifs risquant de fragiliser durablement la confiance dans l’intelligence artificielle générale.

Les colloques universitaires – comme ceux de Paris, Zurich ou Stanford – insistent sur la nécessité de nuancer la thèse d’une bulle purement spéculative : certains chercheurs soulignent la robustesse de la recherche fondamentale, tandis que d’autres appellent à mieux étudier les modèles économiques derrière les projets d’IAG et d’AGI. Le rapport du Sénat français (octobre 2024) montre qu’une majorité de jeunes utilisent déjà l’IA générative dans leurs études, révélant une adhésion large mais aussi des attentes parfois irréalistes.

En définitive, l’été a été marqué par une volonté commune d’approfondir, entre prudence, scepticisme et exploration critique. Ces débats irriguent aussi les enjeux stratégiques suivis dans l’analyse des signaux faibles de la bulle technologique IA et en soulignent l’importance pour la recherche sur l’intelligence artificielle.

La relance des méthodes : nouveaux outils et indicateurs pour suivre la bulle AGI

Pour dépasser la simple observation des marchés, laboratoires, think tanks et institutions internationales développent de nouveaux outils pour suivre et comprendre la dynamique de la bulle AGI. En 2024, la méthodologie du Hype Cycle élaborée par Gartner (voir leur rapport) est régulièrement citée: elle permet d’identifier les pics d’enthousiasme, les réajustements de la perception publique et les phases de désillusion, bien au-delà des fluctuations financières classiques.

L’OCDE, via sa boîte à outils sur la transformation numérique (mai 2024), propose de nouveaux indicateurs évaluant les impacts sociétaux, économiques et environnementaux de l’AGI. Ces instruments prennent en compte la densité des brevets, l’évolution des investissements R&D et le cycle de vie des innovations, afin de mieux anticiper les excès ou signaux d’alerte.

Des laboratoires universitaires (notamment à Paris-Saclay et Zurich) expérimentent de nouveaux indices liant données cognitives issues de la neuroscience computationnelle et variables financières, une approche dite de » finance cognitive « . Ces innovations irriguent les grands débats sur la croissance exponentielle et les disruptions économiques de l’AGI. Les grands think tanks, comme l’Institut Montaigne (France 2040), appellent à croiser indicateurs techniques et suivi des imaginaires collectifs autour de l’AGI.

Cette approche multidisciplinaire vise à bâtir une analyse plus robuste et nuancée, loin de la volatilité médiatique et boursière.

Ruptures, polémiques et fractures disciplinaires

La montée en puissance de l’ia générale et la flambée des discours sur l’AGI ont exacerbé les tensions entre économistes » catastrophistes » et chercheurs de terrain en intelligence artificielle. Lors de forums universitaires récents, comme les Journées de l’économie (Jéco 2024) et les débats au CESE (avis 2025), ces divergences sont devenues très visibles: les premiers alertent sur des risques systémiques pour l’emploi et la stabilité sociale ; les seconds rétorquent que l’analyse économique ignore trop souvent la réalité des avancées scientifiques réelles et » mesure mal » l’impact réel des applications d’AGI.

Les grandes universités, de Zurich à Paris-Saclay, favorisent désormais des équipes de recherche mêlant sciences sociales, philosophie et ingénierie, imposant de fait une interdisciplinarité qui devient la norme. Les débats récents, par exemple autour de l’avis du Sénat français (novembre 2024) et des positions d’experts comme Laurent Alexandre sur l’IA forte, témoignent d’une tension entre vision de rupture et approche incrémentale de la transformation technologique.

Ces fractures intellectuelles ne sont pas sans rappeler l’essor du syndrome AGI sur les marchés financiers, où l’incertitude intellectuelle rejoint l’instabilité économique. Sur le plan méthodologique, l’interdisciplinarité s’impose donc autant pour dépasser les clivages que pour outiller une veille stratégique lucide sur l’intelligence artificielle.

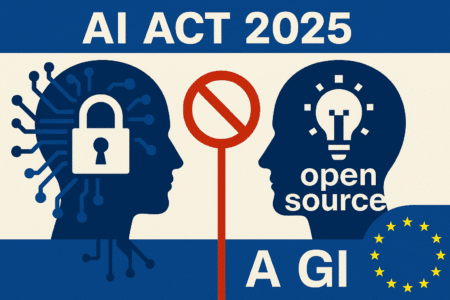

Un nouvel agenda pour une recherche responsable

Au fil des débats et controverses, la communauté scientifique s’organise pour limiter les effets pervers de la bulle sur la recherche en intelligence artificielle générale. On assiste à la publication de charte de bonnes pratiques et recommandations collectives: ainsi, l’UNESCO, le Conseil d’État français (État de la souveraineté 2024), ou encore l’Assemblée nationale multiplient les avis invitant à encadrer les travaux en IAG par l’éthique, la transparence et la coconstruction avec la société civile.

Dans les universités, des initiatives telles que la « responsabilité algorithmique » se traduisent en plans d’action concrets (voir Aix-Marseille Université, novembre 2024). Les travaux menés au Conseil économique, social et environnemental (étude 2024) documentent la montée de recommandations pour limiter les biais algorithmiques et favoriser l’inclusivité. Ce tournant s’accompagne aussi d’un appel à la vigilance contre les « effets bulle »: illusion d’innovation, fuite des talents et fragmentation de la recherche.

L’enjeu est donc double: désamorcer les exagérations tout en accélérant la structuration éthique de l’intelligence artificielle.

Conclusion : Vers une maturité critique de l’écosystème AGI ?

L’année 2024 marque sans conteste un tournant réflexif pour la recherche autour de l’AGI et de la superintelligence artificielle. La communauté s’engage dans un exercice d’autocritique, intégrant désormais l’évaluation des modèles économiques, des risques sociaux et des enjeux éthiques comme parties prenantes du progrès scientifique.

Cette mutation se traduit par des synergies accrues entre chercheurs, institutions et société civile – comme l’illustrent la conférence « La Saga AGI » (consulat de San Francisco, 2024) et les récents rapports européens. L’avenir de la intelligence artificielle générale dépendra en grande partie de la capacité de ses acteurs à anticiper les crises de confiance tout en cultivant une innovation responsable et partagée.

Pour la prochaine génération de chercheurs, ce tournant critique sera autant intellectuel que sociétal, impliquant la co-construction continue avec les parties prenantes et un effort d’éducation du public. Cette maturité, loin de freiner le développement de l’IAG, contribue à faire de l’écosystème AGI un laboratoire de réflexivité et de responsabilité – une évolution essentielle à l’ère des superintelligences.

Pour approfondir les enjeux de readiness mondiale ou de signaux faibles dans la bulle IA, consultez:

– Le gap culturel devant l’AGI selon le rapport Gallup 2025

– La veille stratégique à l’ère de la bulle technologique IA