L’alignement éthique de l’AGI : une priorité internationale en 2026

En 2026, la ia générale (ou AGI) s’est imposée comme une réalité opérationnelle : ses systèmes déploient des capacités équivalentes, et souvent supérieures, à celles de l’humain dans de multiples domaines. L’intelligence artificielle générale n’est plus un sujet réservé aux laboratoires, mais irrigue les entreprises, la recherche, et les administrations publiques de tous les continents.

Ainsi s’est posée avec une acuité croissante la question de » l’alignement » : comment faire en sorte que les objectifs, les valeurs et les résultats générés par une AGI restent en phase avec l’éthique humaine ? Ce défi – appelé « problème d’alignement » – est rapidement devenu central auprès d’acteurs dissemblables : régulateurs, constructeurs, ONG, citoyens. L’augmentation des capacités cognitives de l’AGI amplifie les risques de dérive, de manipulation ou d’arbitraire, rendant l’encadrement crucial. À l’échelle internationale, l’ONU et le Conseil de l’Europe ont proposé des chartes et des cadres de gouvernance, tandis que des initiatives privées (OpenAI, DeepMind, consortiums asiatiques) proposent leurs propres standards d’alignement. Du côté des États, la géopolitique de l’IAG est désormais une réalité, comme l’explore notamment l’article sur le nouvel équilibre mondial de la gouvernance AGI.

L’alignement éthique n’est pas seulement une question de conformité technique, mais touche à l’essence de nos sociétés. Il croise l’ensemble des dilemmes moraux – du respect de la vie privée à la prévention des biais – et impose une vigilance accrue, à mesure que se profile la perspective d’une superintelligence artificielle largement autonome. Pour aller plus loin, consultez aussi cet éclairage sur les normes internationales d’alignement.

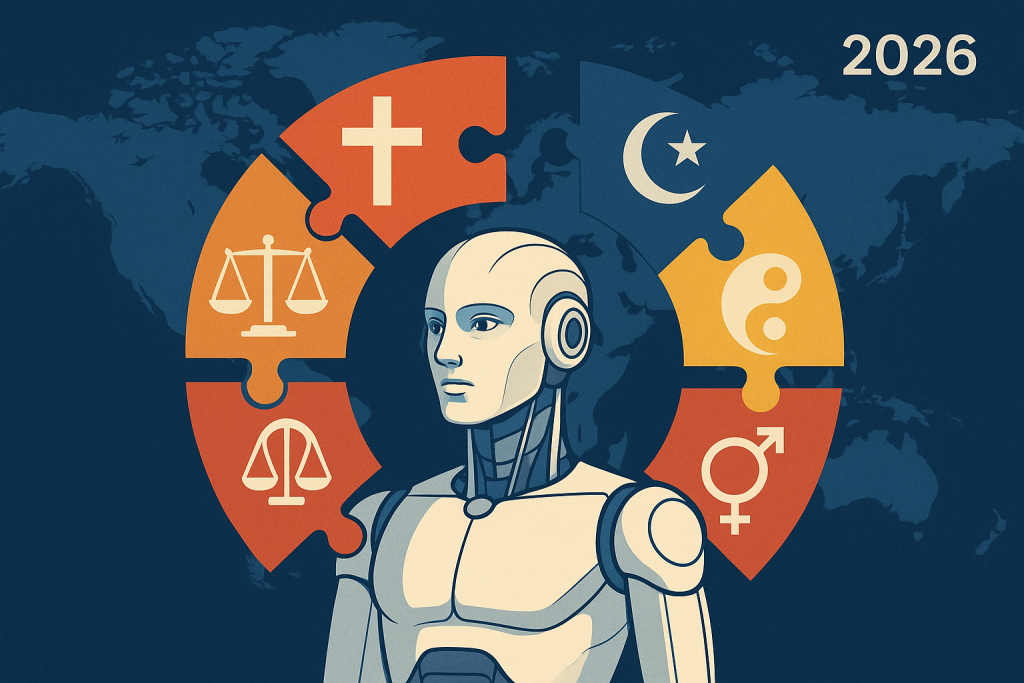

Quand la diversité humaine défie l’alignement global de l’AGI

L’une des difficultés fondamentales du problème d’alignement réside dans la pluralité des systèmes de valeurs à travers le monde. Les sociétés humaines se distinguent par une mosaïque de références culturelles, religieuses, philosophiques et politiques. Ce qui paraît éthique et juste dans une région peut paraître inacceptable ailleurs. Par exemple, la notion de vie privée est interprétée plus strictement en Europe, tandis que certains modèles asiatiques privilégient la sécurité collective au détriment de l’individualisme.

Plusieurs cas ont souligné cette complexité : en 2025, par exemple, un système d’intelligence artificielle destiné à la gestion de crises sanitaires a été simultanément salué pour sa fermeté en Asie tout en étant vivement critiqué pour ses atteintes aux libertés en Occident. Ou encore, des algorithmes éducatifs personnalisés mis en œuvre au Moyen-Orient, ajustant le contenu pédagogique selon les prescriptions religieuses locales, ont généré un débat animé sur la neutralité de l’IA.

Comme le résume le philosophe (fictif) Dr. A. Benyahia, expert en éthique IA : » Tenter d’imposer une convergence universelle revient, à terme, à niveler la richesse humaine et risque de générer une perte de sens. Les approches globales sont séduisantes, mais elles butent sur des réalités profondément ancrées. Un système AGI ‘vraiment global’ ne pourra échapper à des compromis, parfois douloureux. «

Ce constat rejoint les analyses détaillées dans cet article sur les défis éthiques de l’intelligence artificielle générale, où la diversité des visions du vivant, de la justice ou du progrès rend la codification d’un socle commun particulièrement ardue. Cela illustre à quel point l’AGI n’est pas un simple problème technique, mais profondément humain.

Initiatives, blocages et crises : la difficile quête d’un alignement planétaire

Face à la montée en puissance de l’intelligence artificielle générale, la communauté internationale s’est mobilisée par le biais de projets ambitieux – sans toutefois réussir à aplanir les profondes divergences de valeurs. En 2025, l’ONU a proposé la création d’un Observatoire Mondial de l’Alignement, réunissant experts, gouvernements, entreprises et ONG dans le but de produire une matrice de principes éthiques pour l’AGI. De son côté, l’Union européenne a accéléré l’adoption d’un traité sur le développement responsable de l’IA, tandis que des alliances technologiques privées – comme le » Consortium pour une IA fiable » – tentent d’imposer leurs propres référentiels.

Cependant, ces démarches se heurtent à de nombreux blocages. Les États-Unis défendent une IA principalement orientée vers les droits individuels ; la Chine, une vision sécuritaire et collective ; l’Union Africaine milite pour une souveraineté des données adaptée à ses contextes. Un incident frappant de 2025 illustre ces tensions: lors d’une simulation de gestion de crise humanitaire par plusieurs AGI en réseau, une tâche de répartition d’aide fut suspendue, chaque système refusant d’appliquer les règles de l’autre, arguant des priorités divergentes (privauté, urgence, impartialité religieuse). Cette polémique, largement couverte dans la presse, a souligné la persistance du choc des valeurs.

Au-delà des joutes diplomatiques, des mouvements citoyens et des ONG insistent pour une transparence accrue sur les algorithmes de l’IA et une méta-gouvernance – thématique approfondie dans cet article sur le contrôle automatisé de l’AGI.

Ces débats révèlent que la gouvernance mondiale de l’IA générale demeure un chantier ouvert et souvent conflictuel, où les intérêts nationaux, économiques et culturels s’entrechoquent.

Imaginer une AGI respectueuse de la diversité humaine : scénarios et limites

Poursuivre un alignement éthique universel pour l’IAG demeure un immense défi. Pourtant, plusieurs pistes innovantes émergent pour tenter de concilier performance, responsabilité et respect de la pluralité humaine. Parmi elles:

- Les AGI multiculturelles: outils capables d’adapter dynamiquement leur cadre de référence selon la société d’accueil. Exemple: un assistant juridique AGI, « polyéthique », ajustant la pondération des valeurs selon les lois et coutumes locales.

- Les modèles hybrides associant supervision humaine, consensus délibératif et algorithmes d’éthique adaptative.

- L’open source éthique: publication des jeux de données et algorithmes d’alignement, soumise à la validation d’experts globaux, citoyens et ONG.

- La gouvernance partagée, avec des organes internationaux composés d’acteurs multinationaux et multi-sectoriels, capables d’auditer et d’amender en continu les systèmes d’AGI.

Si ces scénarios offrent de réels espoirs, ils posent aussi des limites concrètes : lenteur des processus, difficulté de vérifier l’innocuité des systèmes « ouverts », résistance de certains intérêts nationaux. Surtout, une question demeure: existera-t-il jamais une version d’intelligence artificielle acceptable pour tous? N’y aura-t-il pas toujours une part d’arbitraire ou d’exclusion ?

Cette réflexion est au cœur du débat sur les normes internationales, invitant à repenser la notion même d’universalité dans le contexte de la IA générale.

Conclusion: L’alignement de l’AGI, entre vigilance éthique et nouveau contrat social numérique

L’alignement de l’IAG à l’échelle mondiale cristallise les fractures mais aussi les espoirs d’un nouvel humanisme numérique. Si les obstacles techniques et géopolitiques sont réels, la solution ne se situe sans doute pas dans la seule ingénierie ou régulation, mais dans un patient dialogue collectif, mêlant science, droit, philosophie et engagement citoyen.

La vigilance critique de l’ensemble des parties prenantes reste indispensable pour éviter les dérives et garantir l’intégration de la intelligence artificielle générale dans le respect de la diversité humaine. Peut-être faut-il repenser notre rapport à la technique, privilégier les dispositifs souples et inclusifs, et accepter une part irréductible de diversité dans les usages et les valeurs. L’AGI offre un miroir de nos limites, mais aussi de nos potentiels communs. La quête d’un alignement véritable s’apparente à celle, toujours actuelle, d’un équilibre entre la raison et le sens, le local et l’universel.

À lire égalementpour approfondir ces perspectives: les enjeux géopolitiques de l’alignement de la Superintelligence.