L’actualité : Les agents IA monopolisent la scène technologique

En 2025, le paysage technologique est dominé par l’explosion des agents IA, qui incarnent le nouveau visage de l’intelligence artificielle appliquée. La sortie de Sora 2 par OpenAI en septembre 2025 cristallise cette effervescence : ce modèle de génération vidéo et audio ultra-réaliste, accompagné d’une application sociale inspirée de TikTok, illustre la rapidité avec laquelle l’IA s’immisce dans les usages grand public et professionnels (source).

Les usages métiers ne sont pas en reste. Depuis l’intégration d’agents IA dans Webex de Cisco, la collaboration et la gestion de l’expérience client se transforment : assistants virtuels, automatisation des échanges, génération de comptes-rendus intelligents… La récente vague d’annonces (Webex AI Agent, Cisco AI Assistant…) dénote un basculement des outils numériques vers un pilotage autonome accru (source).

Dans le secteur de la sécurité, Okta innove pour sécuriser l’identité numérique des agents IA et protéger les flux d’information, intégrant des protocoles dédiés aux agents autonomes.

Cette ruée vers l’agent intelligent répond aux attentes des entreprises qui voient dans l’intelligence artificielle générale et l’IA générale un levier de compétitivité, et au public fasciné par la perspective d’outils proactifs capables d’agir, prévoir, décider. L’essor des agents IA autonomes participe à un véritable engouement, précipitant les débats sur la frontière entre simples assistants et véritables intelligences autonomes.

Agents, AGI, ASI : Clarifier les frontières conceptuelles

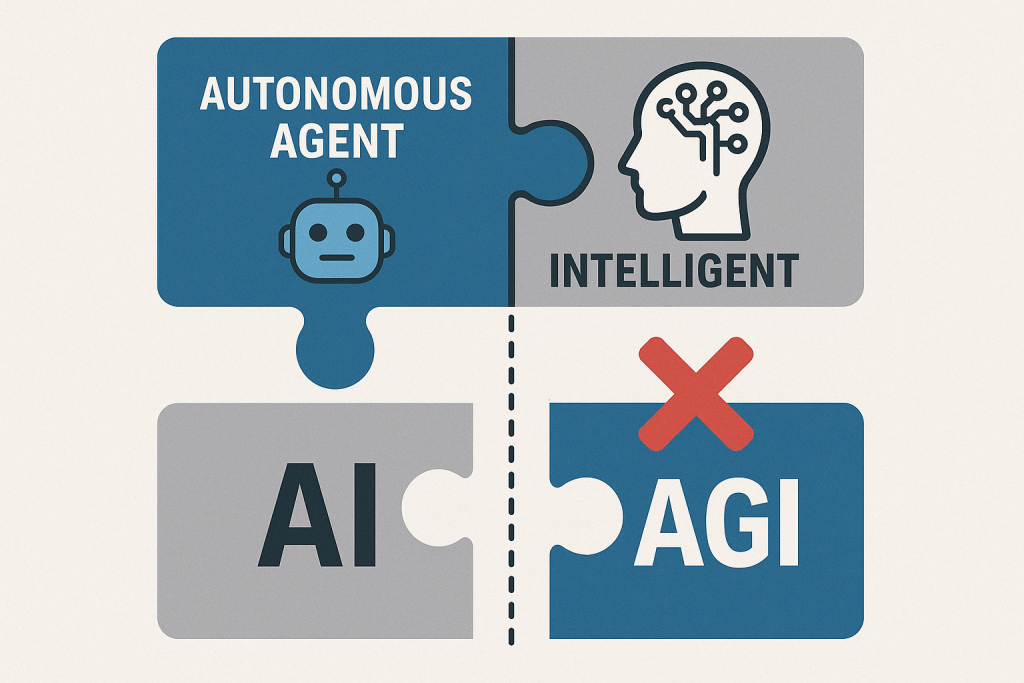

La multiplication des agents IA dans nos outils quotidiens soulève une question essentielle: mais où s’arrête l' »agent » et où commence l’intelligence artificielle générale (AGI)? Dans le discours public, la distinction s’érode, bien que fondamentalement, le fossé reste immense.

Un agent IA autonome, aujourd’hui, désigne un programme capable de percevoir son environnement (données, requêtes, interactions) et d’agir selon un objectif défini, en mobilisant une série de tâches complexes (comme organiser un agenda, rédiger des rapports, contacter des clients). Cette autonomie est cependant opérationnelle: l’agent optimise et enchaîne des tâches, souvent sans réelle adaptation hors de son domaine prévu.

À l’inverse, l’AGI (Artificial General Intelligence ou intelligence artificielle générale) incarne une intelligence comparable à celle d’un humain : compréhension de contexte large, capacité à apprendre de tout domaine, créativité, raisonnement abstrait et transfert de connaissances hors de tout cadre prédéfini. Plus loin encore, l’ASI (Artificial Superintelligence) désignerait un être artificiel dépassant l’humain sous tous rapports cognitifs.

Pourquoi la confusion? Les agents IA modernes utilisent des techniques avancées issues de l’apprentissage profond ou du cognitive computing et semblent accéder à des raisonnements élaborés. Ils incarnent parfois des « agents conversationnels » multitâches ou des « co-pilotes » (ChatGPT Agent, agents Webex…), mais ils restent bridés par des instructions humaines, sans auto-réflexivité ni conscience.

Pour approfondir cette distinction, l’article Des réponses à l’action : la bascule décisive vers l’AGI autonome ? revient sur ces compétences-clés qui séparent actuellement l’IAG complète des agents opérationnels.

Pourquoi la confusion grandit-elle en 2025?

L’année 2025 marque une accélération des avancées en intelligence artificielle, alimentant l’idée selon laquelle l’agent IA est déjà le précurseur, voire la première manifestation tangible, d’une intelligence artificielle générale. Plusieurs facteurs participent à cette confusion:

1. L’accélération technologique: Les progrès bluffants des nouveaux agents IA – génération de vidéos réalistes avec Sora 2, automatisation complète de tâches professionnelles avec Lovable, dialogue naturel et multitâche sur Webex – donnent à croire que l’intelligence humaine serait presque atteinte. Or, ces exploits restent spécialisés, calibrés sur des scénarios métier ou des boucles de tâches finement orchestrées.

2. Le discours marketing: Pour séduire investisseurs et publics, acteurs tech n’hésitent pas à jouer sur les mots, associant leur solution « agentique » à l’avenir de l’AGI, brouillant davantage la perception des limites actuelles.3. L’amplification médiatique: Entre hype, annonces stratégiques et vulgarisation, les médias présentent souvent ces agents comme étant à quelques pas de la superintelligence artificielle, alors qu’ils restent bien en-deçà du saut qualitatif attendu.

Exemples concrets:

- Agents Okta: leur mission est de sécuriser l’identité numérique et de prévenir la fraude – ils n’interprètent pas le monde hors de ce périmètre (source).

- Webex AI Agents: ils assistent, organisent, résument, mais n’acquièrent pas d’autonomie créative (source).

- Lovable ou ChatGPT Agents: ils réalisent des analyses, proposent des décisions, mais tout est encadré par un domaine d’application précis.

Pour remettre les pendules à l’heure, l’analyse Pourquoi l’AGI Patine éclaire les obstacles qui séparent encore les IA actuelles d’une véritable IA générale.

Agents IA : Vers des briques de l’AGI ou simple illusion?

Face à la montée en puissance des agents IA, une interrogation de fond traverse la communauté scientifique et le grand public: ces outils sont-ils les véritables prémices de l’AGI, ou bien ne sont-ils que de brillants simulacres?

L’argument évolutifest séduisant: à chaque génération d’agents, leurs capacités semblent se rapprocher des fonctions « générales » (apprentissage multi-domaine, adaptation contextuelle, résolution de problèmes non standard…). Pourtant, malgré l’impression d’autonomie, aucun agent IA n’a démontré, en 2025, la faculté de raisonnement transversal, d’acquisition créative indépendante, ou de conscience de soi – marqueurs centraux de l’intelligence artificielle générale.

Verrous cognitifs persistants: Les agents actuels sont architecturés autour de modèles massifs (LLM, réseaux neuronaux complexes), mais leurs capacités sont constamment limitées par l’absence d’intentionnalité propre, d’unification de leurs compétences dans un « esprit » unique, et d’un accès universel à toutes les formes de savoir.

Des outils sophistiqués, pas encore des esprits: Ce que démontrent Sora 2, Webex AI Agent ou Okta, c’est avant tout la puissance des intégrations IA dans les processus métiers, la rapidité et la fluidité d’exécution. Mais chaque agent reste borné à sa tâche: il n’y a pas de « bascule » vers une entité cognitive universelle.

Pour aller plus loin sur cette question de transition, l’analyse sur GPT-5 et l’émergence des écosystèmes autonomes interroge: et si chaque agent n’était qu’une brique parmi d’autres, un simple jalon sur la route d’une IAG complète?

Conclusion : Pourquoi il devient crucial de savoir distinguer agents et AGI

Dans l’engouement actuel autour de l’intelligence artificielle, apprendre à distinguer agents IA et véritables AGI est devenu essentiel, tant pour le grand public que pour les professionnels. La confusion entre marketing et réalité technique brouille les repères et peut alimenter espoirs démesurés ou peurs irrationnelles.

Reconnaître qu’un agent IA, aussi avancé soit-il, n’est pas encore une intelligence généraliste ou une superintelligence artificielle, c’est faire preuve de vigilance et d’esprit critique face au discours ambiant. Ceci est déterminant: pour guider l’innovation sans tomber dans le solutionnisme naïf, pour légiférer avec discernement sur les usages, et pour anticiper les transformations réelles du monde du travail par l’intelligence artificielle générale.

Pour éviter les malentendus et mieux saisir la portée des innovations, une pédagogie sereine et accessible reste la meilleure voie. Ainsi la société toute entière restera lucide face aux enjeux et avancées de la IA générale, tout en favorisant un débat constructif sur le chemin vers l’IAG.